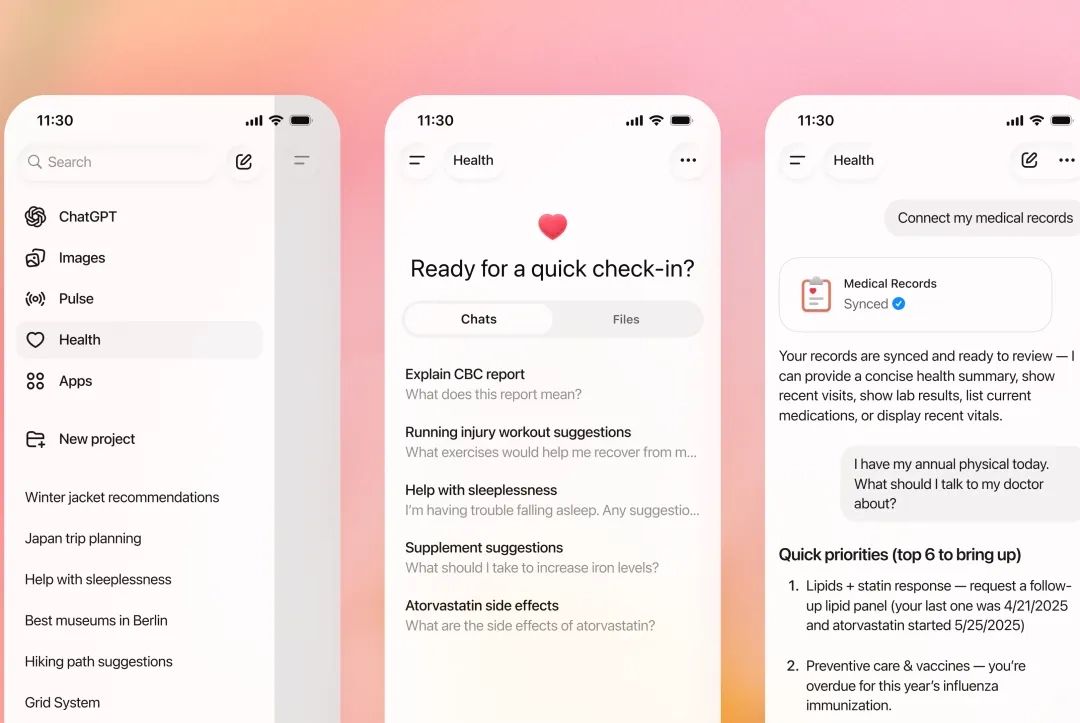

OpenAI 这周持续在传达 AI 可作为“医疗盟友”的概念——就在今天,该公司推出了一款契合这一理念的产品:ChatGPT Health。

ChatGPT Health 是 ChatGPT 内置的一个沙盒标签页,其设计初衷是为用户打造一个更安全、更具个性化的环境来咨询健康相关问题,它具备与 ChatGPT 其他板块不同的聊天记录和记忆功能。公司鼓励用户关联个人病历以及各类健康应用,像 Apple Health、Peloton、MyFitnessPal、Weight Watchers 和 Function 等,目的是“获取更贴合个人情况、更符合实际的问题解答”。其中,建议关联病历,能让 ChatGPT 对实验室检测结果、就诊小结以及临床病史进行分析;MyFitnessPal 和 Weight Watchers 可提供饮食方面的指导;Apple Health 能提供健康与健身数据,涵盖“运动、睡眠和活动规律”;而 Function 则可用于获取实验室测试的相关洞察。

在医疗记录整合方面,OpenAI透露正与b.well展开合作。借助b.well与约220万家医疗服务机构已建立的合作关系,用户将能通过其提供的后端集成功能完成医疗记录的上传。当前,ChatGPT Health服务处于早期测试阶段,因此要求用户注册等待名单以申请访问权限。不过该产品后续会逐步扩大覆盖范围,面向所有用户开放,不受订阅等级的限制。

公司在博客文章里清楚说明,ChatGPT Health“不用于诊断或治疗疾病”,可它没办法彻底约束用户在结束聊天后会怎样使用这个人工智能。公司自身也坦言,在医疗资源匮乏的农村地区,用户平均每周会发送近60万条和医疗相关的信息,而且ChatGPT里有七成的医疗对话“是在常规门诊时间之外进行的”。今年八月,医生们公布了一份报告,提到有一名男子听从ChatGPT的建议,把饮食里的盐换成了溴化钠,结果住院好几周,还患上了一种18世纪的病症。谷歌的AI General推出后没几周就登上了新闻头条,事由是它给出了危险建议,像在披萨上涂胶水之类的;《卫报》最近的一项调查则发现,危险的健康建议依然存在,其中包括关于肝功能检测、女性癌症检测的错误内容,以及给胰腺癌患者推荐的不实饮食建议。

OpenAI在一篇博客文章中指出,依据其“去标识化的对话分析”数据,目前全球每周有超2.3亿人向ChatGPT咨询健康与养生方面的问题。此外,OpenAI还提到,过去两年里,他们联合了260多位医生,围绕30个重点领域,收集了超60万次模型输出的反馈意见,以此助力产品回答内容的优化与完善。

OpenAI在其博客中表示:“ChatGPT能够协助你了解近期的检测结果,为与医生的预约做准备,获取关于调整饮食和锻炼计划的建议,或者依据你的医疗模式来理解不同保险选项之间的利弊权衡。”

OpenAI在其博客文章中似乎刻意回避提及的健康领域部分:心理健康。存在不少成年人或未成年人在向ChatGPT倾诉后选择自杀的案例,OpenAI在博客文章里仅含糊地提到用户能够在健康产品中自定义说明,“以此避免涉及敏感话题”。在周三与记者的简报会上,当被问到ChatGPT Health是否也会对心理健康咨询进行总结并给出相关建议时,OpenAI应用首席执行官Fidji Simo回应道:“心理健康毫无疑问是健康的组成部分,我们发现有很多人在心理健康相关的交流中会选择使用ChatGPT。”她还补充表示,这款新产品“能够应对你健康的任何方面,其中就包括心理健康……我们十分注重确保在遇到困境时做出恰当回应,并向医疗专业人员、亲友或者其他资源寻求帮助”。

该产品或许会加剧健康焦虑问题,像疑病症状就可能因此加重。当被问到OpenAI有没有推出相关保障机制,来避免这类疾病患者在使用ChatGPT Health时病情出现恶化,Simo回应称:“我们投入了很多精力对模型进行调整,目的是保证提供的信息既详实又绝不夸大其词,要是情况需要采取实际行动,我们会直接引导用户向医疗系统寻求帮助。”